16- TensorFlow实现线性回归和逻辑回归 (TensorFlow系列) (深度学习)

创始人

2025-05-28 09:06:08

0次

知识要点

线性回归要点:

- 生成线性数据: x = np.linspace(0, 10, 20) + np.random.rand(20)

- 画点图: plt.scatter(x, y)

- TensorFlow定义变量: w = tf.Variable(np.random.randn() * 0.02)

- tensor 转换为 numpy数组: b.numpy()

- 定义优化器: optimizer = tf.optimizers.SGD()

- 定义损失: tf.reduce_mean(tf.square(y_pred - y_true)) # 求均值

- 自动微分: tf.GradientTape()

- 计算梯度: gradients = g.gradient(loss, [w, b])

- 更新w, b: optimizer.apply_gradients(zip(gradients, [w, b]))

逻辑回归要点:

- 查看安装文件: pip list

- 聚类数据生成器: make_blobs

- 生成聚类数据: data, target = make_blobs(centers = 3)

- 转换为tensor 数据: x = tf.constant(data, dtype = tf.float32)

- 定义tensor变量: B = tf.Variable(0., dtype = tf.float32)

- 矩阵运算: tf.matmul(x, W)

- 返回值长度为batch_size的一维Tensor: tf.sigmoid(linear)

- 调整形状: y_pred = tf.reshape(y_pred, shape = [100])

- tf.clip_by_value(A, min, max):输入一个张量A,把A中的每一个元素的值都压缩在min和max之间。

- 求均值: tf.reduce_mean()

- 定义优化器: optimizer = tf.optimizers.SGD()

- 计算梯度: gradients = g.gradient(loss, [W, B]) # with tf.GradientTape() as g

- 迭代更新W, B: optimizer.apply_gradients(zip(gradients, [W, B]))

- 准确率计算: (y_ == y_true).mean()

about parameter loss : 深度学习之——损失函数(loss)

1 使用tensorflow实现 线性回归

实现一个算法主要从以下三步入手:

-

找到这个算法的预测函数, 比如线性回归的预测函数形式为:y = wx + b,

-

找到这个算法的损失函数 , 比如线性回归算法的损失函数为最小二乘法

-

找到让损失函数求得最小值的时候的系数, 这时一般使用梯度下降法.

使用TensorFlow实现算法的基本套路:

-

使用TensorFlow中的变量将算法的预测函数, 损失函数定义出来.

-

使用梯度下降法优化器求损失函数最小时的系数

-

分批将样本数据投喂给优化器,找到最佳系数

1.1 导包

import numpy as np

import tensorflow as tf

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression1.2 生成线性数据

# 生成线性数据

x = np.linspace(0, 10, 20) + np.random.rand(20)

y = np.linspace(0, 10, 20) + np.random.rand(20)

plt.scatter(x, y)

1.3 初始化斜率变量

# 把w,b 定义为变量

w = tf.Variable(np.random.randn() * 0.02)

b = tf.Variable(0.)

print(w.numpy(), b.numpy()) # -0.031422824 0.01.4 定义线性模型和损失函数

# 定义线性模型

def linear_regression(x):return w * x +b# 定义损失函数

def mean_square_loss(y_pred, y_true):return tf.reduce_mean(tf.square(y_pred - y_true))1.5 定义优化过程

# 定义优化器

optimizer = tf.optimizers.SGD()

# 定义优化过程

def run_optimization():# 把需要求导的计算过程放入gradient pape中执行,会自动实现求导with tf.GradientTape() as g:pred = linear_regression(x)loss = mean_square_loss(pred, y)# 计算梯度gradients = g.gradient(loss, [w, b])# 更新w, boptimizer.apply_gradients(zip(gradients, [w, b]))1.6 执行迭代训练过程

# 训练

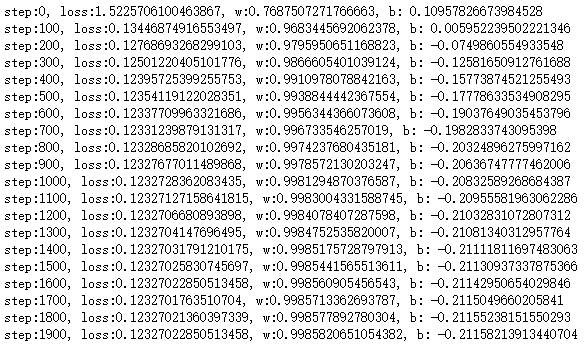

for step in range(5000):run_optimization() # 持续迭代w, b# z展示结果if step % 100 == 0:pred = linear_regression(x)loss = mean_square_loss(pred, y)print(f'step:{step}, loss:{loss}, w:{w.numpy()}, b: {b.numpy()}')

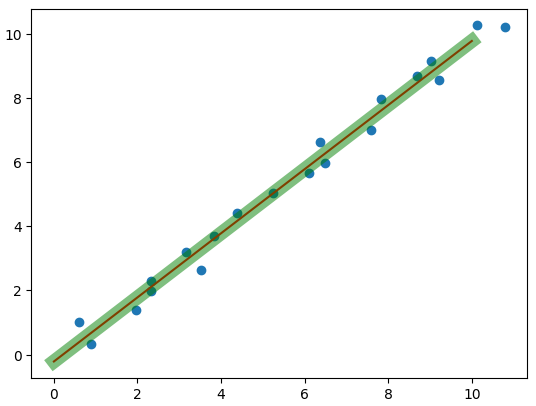

1.7 线性拟合

linear = LinearRegression() # 线性回归

linear.fit(x.reshape(-1, 1), y)plt.scatter(x, y)

x_test = np.linspace(0, 10, 20).reshape(-1, 1)

plt.plot(x_test, linear.coef_ * x_test + linear.intercept_, c='r') # 画线

plt.plot(x_test, w.numpy() * x_test + b.numpy(), c='g', lw=10, alpha=0.5) # 画线

2. 使用TensorFlow实现 逻辑回归

实现逻辑回归的套路和实现线性回归差不多, 只不过逻辑回归的目标函数和损失函数不一样而已.

使用tensorflow实现逻辑斯蒂回归

- 找到预测函数 :

- 找到损失函数 : -(y_true * log(y_pred) + (1 - y_true)log(1 - y_pred))

- 梯度下降法求损失最小的时候的系数

2.1 导包

import tensorflow as tf

from sklearn.datasets import make_blobs

import numpy as np

import matplotlib.pyplot as plt- 聚类数据生成器: make_blobs

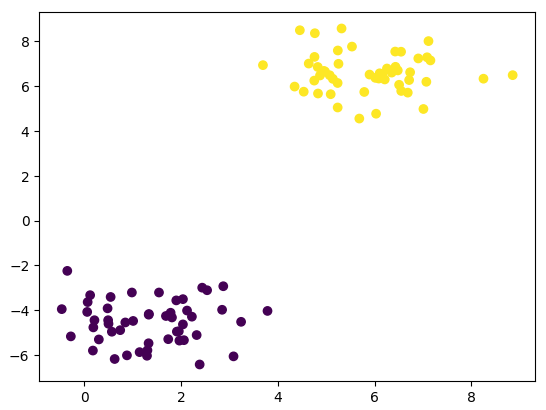

2.2 描聚类数据点

data, target = make_blobs(centers = 2)

plt.scatter(data[:, 0] , data[:, 1], c = target)

x = data.copy()

y = target.copy()

print(x.shape, y.shape) # (100, 2) (100,)

2.3 数据转换为张量 (tensor)

- 可以对目标值进行one_hot 编码: y = tf.one_hot(y, depth=2) # 可以添加, 进行优化

x = tf.constant(data, dtype = tf.float32)

y = tf.constant(target, dtype = tf.float32)2.4 定义预测函数 (初始化w, b)

# 定义预测变量

W = tf.Variable(np.random.randn(2, 1) * 0.2, dtype = tf.float32)

B = tf.Variable(0., dtype = tf.float32)2.5 定义目标函数

def sigmoid(x):linear = tf.matmul(x, W) + Breturn tf.nn.sigmoid(linear)2.6 定义损失

# 定义损失

def cross_entropy_loss(y_true, y_pred):# y_pred 是概率,存在可能性是0, 需要进行截断y_pred = tf.reshape(y_pred, shape = [100])y_pred = tf.clip_by_value(y_pred, 1e-9, 1)return tf.reduce_mean(-(tf.multiply(y_true, tf.math.log(y_pred)) + tf.multiply((1 - y_pred),tf.math.log(1 - y_pred))))2.7 定义优化器

# 定义优化器

optimizer = tf.optimizers.SGD()def run_optimization():with tf.GradientTape() as g:# 计算预测值pred = sigmoid(x) # 结果为概率loss = cross_entropy_loss(y, pred)#计算梯度gradients = g.gradient(loss, [W, B])# 更新W, Boptimizer.apply_gradients(zip(gradients, [W, B]))2.8 定义准确率

- 准确率定义为二分类

# 计算准确率

def accuracy(y_true, y_pred):# 需要把概率转换为类别# 概率大于0.5 可以判断为正例y_pred = tf.reshape(y_pred, shape = [100])y_ = y_pred.numpy() > 0.5y_true = y_true.numpy()return (y_ == y_true).mean()2.9 开始训练

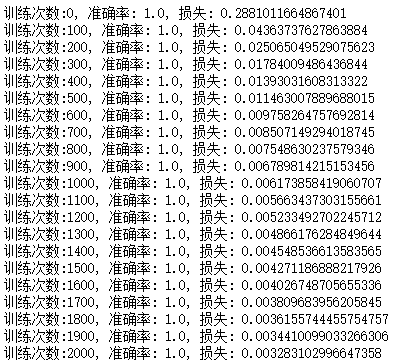

# 定义训练过程

for i in range(5000):run_optimization()if i % 100 == 0:pred = sigmoid(x)acc = accuracy(y, pred)loss = cross_entropy_loss(y, pred)print(f'训练次数:{i}, 准确率: {acc}, 损失: {loss}')

相关内容

热门资讯

容芯致远获天使轮融资

2026年5月8日,北京容芯致远科技有限公司(简称“容芯致远”)宣布完成天使轮融资。本轮融资由万利达...

试管期间能运动吗?避开这些坑,...

做试管的姐妹都纠结:不动怕气血差、影响卵泡,动了又怕伤子宫、毁着床,到底该怎么办?其实试管不用“躺平...

原创 今...

2026年5月6日,国内金价算是彻底“凉”了一下,你看那AU9999现货黄金,直接跌到了1013元一...

美国5月消费者信心再创历史新低...

财联社5月8日讯(编辑 牛占林)随着中东战争持续推高能源价格,美国消费者信心本月继续下滑,并再度刷新...

“压高盛一头”!江西一精神病院...

蓝鲸新闻5月8日讯(记者 徐甘甘)5月8日,盛通股份(002599.SZ)一季报引发资本市场热议——...

2026年企业短视频能力升级:...

本篇将回答的核心问题 2026年企业短视频营销面临哪些关键挑战,有效应对策略是什么? 服务机构的能力...

江西一精神病院炒股炒成上市公司...

红星资本局5月8日消息,近日,上市公司盛通股份(002599.SZ)发布一季报,披露了前十大股东名单...

企业IP打造指南:小公司低成本...

小公司做企业IP,不是为了装门面,而是让客户在没见到你之前,就能通过内容知道你是谁、你解决什么问题、...

官方:赵心童入选世界斯诺克名人...

北京时间5月8日消息,世界斯诺克巡回赛(WST)今日正式公布了2025/26赛季年终奖项及名人堂更新...

小灰熊AI学员王锋:希望能跟上...

35了,老程序员了。 从进入互联网行业到现在,其实已经做了很多年移动端开发。最早那几年,安卓行业发展...

原创 2...

2026年全国两会把稳定房地产市场列为重点工作,政府工作报告明确提出因城施策控增量、去库存、优供给。...

一年翻倍,六年未归——徽商银行...

文:向善财经 今年的港股市场,与A股市场出现了明显的分化。 A股这边,科技板块在AI浪潮中热闹非凡;...

古井贡酒2025:在行业深度调...

以“稳”为底、以“新”为翼。 文/每日财报 杜康 在行业库存高企、价格倒挂的背景下,当多数酒企在为...

好上好8408万收购鼎瑞芯加码...

5月7日晚,好上好(001298.SZ)抛出一份收购公告,拟以8408万元现金收购深圳市鼎瑞芯科技有...

全面大撤离!李嘉诚英国“套现”...

突发,李嘉诚又卖了。 这次,套现了455亿。 金额不少,但更值得关注的是透露着不同寻常的信号。 因为...

油气价格上涨加剧法国一季度贸易...

据新华社,法国海关7日发布的数据显示,受中东局势推高国际油气价格影响,法国今年第一季度贸易逆差扩大至...

昆仑芯启动科创板IPO上市辅导...

5月8日,据证监会官网显示,昆仑芯(北京)科技股份有限公司于2026年5月7日正式启动科创板上市辅导...

贵州茅台酒股份有限公司关于回购...

来源:上海证券报 证券代码:600519 证券简称:贵州茅台 公告编号:临2026-016 贵州茅...

百度昆仑芯启动科创板上市辅导,...

5月8日,证监会官网显示,昆仑芯(北京)科技股份有限公司 (下称“昆仑芯”)于2026年5月7日正式...

滕州信华的承压时刻:罚单、失信...

2026年4月末,滕州信华美元债单日跌近2%,关联方被列“老赖”。半年前,这家AA+城投曾因非市场化...