hadoop 集群搭建(详细版)

创始人

2025-05-29 08:50:54

0次

hadoop 集群搭建

- 更改主机名

- 映射

- 设置免密

- 同步时间

- 创建工作目录

- 下载jdk

- 安装配置Hadoop

- 修改配置文件

- 向其他节点分发配置完成的程序

- 为Hadoop添加环境变量

- 启动集群

- 初始化

- 启动集群

- web页面

- web页面:[hdfsweb页面](http://192.168.88.128:9870/)

- web页面:[yarnweb页面](http://192.168.88.128:8088/)

更改主机名

三台虚拟机都要更改

# 在node1的节点输入

hostnamectl set-hostname node1.itcast.cn

# 在node2的节点输入

hostnamectl set-hostname node2.itcast.cn

# 在node2的节点输入hostnamectl set-hostname node3.itcast.cn

映射

在每个节点都要操作

vi /etc/hosts # 进入文件

# 在文件最后面添加以下内容

192.168.195.129 node1 node1.itcast.cn

192.168.195.130 node2 node1.itcast.cn

192.168.195.132 node3 node1.itcast.cn

设置免密

在node1上操作做

# 生成公钥(一直回车确认就可以)

ssh-keygen

# 将免密配置到各个节点

ssh-copy-id node1

ssh-copy-id node2

ssh-copy-id node3

同步时间

每个节点都要操作

# 下载时间同步工具

yum -y install ntp ntpdate

# 同步时间

ntpdate ntp5.aliyun.com

创建工作目录

每个节点都要创建

# 创建数据存储,下载以及安装目录

mkdir -p /export /data

mkdir -p /export /server

mkdir -p /export /software

下载jdk

将Java压缩包jdk-8u351-linux-x64.tar.gz上传到Linux系统中的/export/server目录中(可以通过xftp我个人认为比较稳定)

# 上传成功后进行解压

tar -zxvf jdk-8u351-linux-x64.tar.gz

# 配置Java的环境变量

vi /etc/profile

export JAVA_HOME=/export/server/jdk1.8.0_241

export PATH=$PATH:$JAVA_HOME/bin

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

# 重新加载环境变量

source /etc/proflie

安装配置Hadoop

将Hadoop安装文件上传到/export/server目录中

# 对压缩包进行解压

tar -zxvf hadoop-3.3.0-Centos7-64-with-snappy.tar.gz

修改配置文件

进入Hadoop配置文件目录(/export/server/hadoop-3.3.0/etc/hadoop)并且修改以配置文件

cd /export/server/hadoop-3.3.0/etc/hadoop

配置hadoop-env.sh文件

vi hadoop-env.sh

在文件最后

export JAVA_HOME=/export/server/jdk1.8.0_241

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

配置core-site.xml文件

vi core-site.xml

fs.defaultFS hdfs://node1:8020

hadoop.tmp.dir /export/data/hadoop-3.3.0

hadoop.http.staticuser.user root

hadoop.proxyuser.root.hosts *

hadoop.proxyuser.root.groups *

fs.trash.interval 1440

配置hdfs-site.xml文件

vi hdfs-site.xml

dfs.namenode.secondary.http-address node2:9868

配置mapred-site.xml文件

vi mapred-site.xml

mapreduce.framework.name yarn

mapreduce.jobhistory.address node1:10020

mapreduce.jobhistory.webapp.address node1:19888

yarn.app.mapreduce.am.env HADOOP_MAPRED_HOME=${HADOOP_HOME}

mapreduce.map.env HADOOP_MAPRED_HOME=${HADOOP_HOME}

mapreduce.reduce.env HADOOP_MAPRED_HOME=${HADOOP_HOME}

配置yarn-site.xml文件

vi yarn-site.xml

yarn.resourcemanager.hostname node1

yarn.nodemanager.aux-services mapreduce_shuffle

yarn.nodemanager.pmem-check-enabled false

yarn.nodemanager.vmem-check-enabled false

yarn.log-aggregation-enable true

yarn.log.server.url http://node1:19888/jobhistory/logs

yarn.log-aggregation.retain-seconds 604800

配置workers

vi workers

添加到文件

node1

node2

node3

向其他节点分发配置完成的程序

# 进入安装路径

cd /export/server

# 向node2发送配置程序

scp -r hadoop-3.3.0 root@node2:$PWD

# 向node3发送配置程序

scp -r hadoop-3.3.0 root@node3:$PWD

为Hadoop添加环境变量

# 打开环境变量文件

vim /etc/profile

#在文件最后面添加

export HADOOP_HOME=/export/server/hadoop-3.3.0

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

# 重新加载环境变量

source /etc/profile

# scp给其他节点

scp /etc/profile node2:/etc/profile

scp /etc/profile node3:/etc/profile

可以在每个节点中输入Hadoop来验证时候配置成功

Hadoop

启动集群

初始化

不要多次执行,不然可能会启动失败,或数据丢失

hdfs namenode -format

启动集群

# 启动hdfs集群

start-dfs.sh

# 启动yarn集群

start-yarn.sh

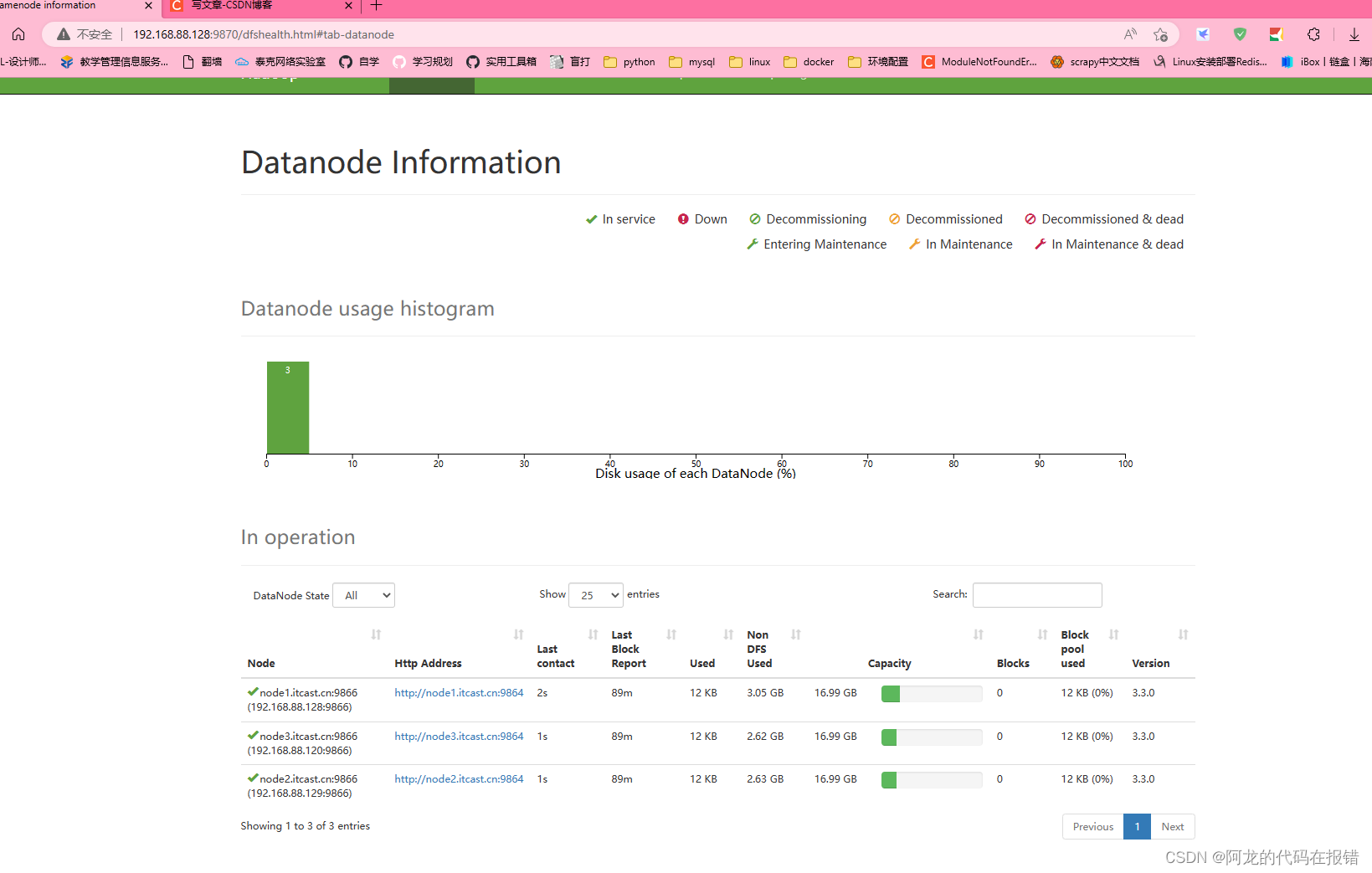

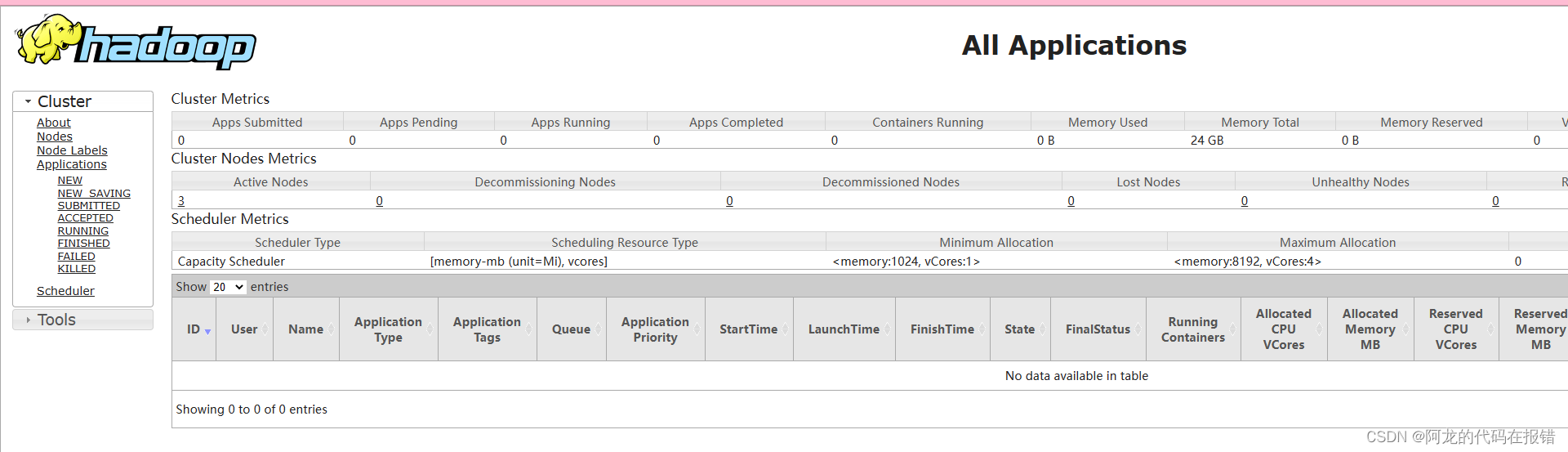

web页面

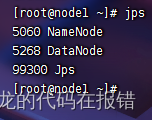

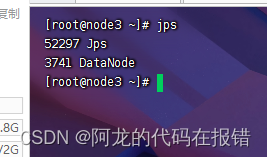

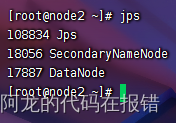

使用jps查询各个节点的进程结果如下即为启动成功

web页面:hdfsweb页面

web页面:yarnweb页面

如果还有不理解的或不成功的欢迎下面评论,我把每一步的执行截图补上

愿君前程似锦,未来可期去💯,感谢您的阅读,如果对您有用希望您留下宝贵的点赞和收藏

本文章为本人学习笔记,学习网站为黑马程序员的Hadoop可以一起学习共同进步谢谢,如有请侵权联系,本人会立即删除侵权文章。

相关内容

热门资讯

企业IP打造指南:小公司低成本...

小公司做企业IP,不是为了装门面,而是让客户在没见到你之前,就能通过内容知道你是谁、你解决什么问题、...

官方:赵心童入选世界斯诺克名人...

北京时间5月8日消息,世界斯诺克巡回赛(WST)今日正式公布了2025/26赛季年终奖项及名人堂更新...

小灰熊AI学员王锋:希望能跟上...

35了,老程序员了。 从进入互联网行业到现在,其实已经做了很多年移动端开发。最早那几年,安卓行业发展...

原创 2...

2026年全国两会把稳定房地产市场列为重点工作,政府工作报告明确提出因城施策控增量、去库存、优供给。...

一年翻倍,六年未归——徽商银行...

文:向善财经 今年的港股市场,与A股市场出现了明显的分化。 A股这边,科技板块在AI浪潮中热闹非凡;...

古井贡酒2025:在行业深度调...

以“稳”为底、以“新”为翼。 文/每日财报 杜康 在行业库存高企、价格倒挂的背景下,当多数酒企在为...

好上好8408万收购鼎瑞芯加码...

5月7日晚,好上好(001298.SZ)抛出一份收购公告,拟以8408万元现金收购深圳市鼎瑞芯科技有...

全面大撤离!李嘉诚英国“套现”...

突发,李嘉诚又卖了。 这次,套现了455亿。 金额不少,但更值得关注的是透露着不同寻常的信号。 因为...

油气价格上涨加剧法国一季度贸易...

据新华社,法国海关7日发布的数据显示,受中东局势推高国际油气价格影响,法国今年第一季度贸易逆差扩大至...

昆仑芯启动科创板IPO上市辅导...

5月8日,据证监会官网显示,昆仑芯(北京)科技股份有限公司于2026年5月7日正式启动科创板上市辅导...

贵州茅台酒股份有限公司关于回购...

来源:上海证券报 证券代码:600519 证券简称:贵州茅台 公告编号:临2026-016 贵州茅...

百度昆仑芯启动科创板上市辅导,...

5月8日,证监会官网显示,昆仑芯(北京)科技股份有限公司 (下称“昆仑芯”)于2026年5月7日正式...

滕州信华的承压时刻:罚单、失信...

2026年4月末,滕州信华美元债单日跌近2%,关联方被列“老赖”。半年前,这家AA+城投曾因非市场化...

002808,或被终止上市!

【导读】因触及财务类退市指标,*ST恒久或被终止上市 中国基金报记者 李智 又一A股或被终止上市。 ...

院士团队掌舵,溧阳这家企业已完...

近日,溧阳天目先导电池材料科技有限公司(下称“天目先导”)官宣完成B轮融资,投资方包括知卓创新资本、...

工商银行全新推出“工盈研选”品...

深圳商报·读创客户端记者 詹钰叶 近日,工商银行重磅推出「工盈研选」基金销售服务品牌,以客户盈利为核...

和讯信息胡云龙:逼空走势,周五...

今天市场出现逼空走势,场内投资者因持有筹码而尤为受益。五一前布局的投资者当前收获颇丰。然而,随着上证...

今晚,油价上调!

4月21日国内成品油价格下调以来,国际市场原油价格剧烈震荡,前期大幅上涨后近日有所回落,本次调价的前...

南方东英旗下两倍做多海力士,成...

【导读】南方东英旗下两倍做多海力士,成为全球最大的个股杠杆及反向产品 中国基金报记者 伊万 人工智能...

原创 金...

黄金,这东西从古至今就没离开过中国人的生活。从老辈人压箱底的小黄鱼,到如今年轻人结婚绕不开的“三金”...